Kaggle数据竞赛全程解析与获胜策略深度指南

文章摘要:Kaggle数据竞赛是数据科学领域的一项全球性挑战,吸引了无数数据科学爱好者、工程师和学者的参与。本文将全面解析Kaggle数据竞赛的全过程,并结合获胜策略为读者提供实用的指南。文章首先介绍如何准备和理解竞赛数据,包括数据预处理和特征工程的技巧;然后深入探讨如何搭建机器学习模型并进行调优,如何在竞赛中与团队合作以及如何分析并理解竞赛评估指标等方面。通过本篇文章,读者将获得一套系统的Kaggle竞赛攻略,帮助提升获胜的可能性。

1、竞赛准备与数据理解

Kaggle数据竞赛的成功,首先源于对竞赛数据的深入理解与分析。在竞赛开始前,参赛者应该首先仔细阅读比赛规则和数据描述文档,明确任务目标。例如,若竞赛任务是分类问题,则需特别关注分类标签、特征类型、数据分布等内容。

在获得竞赛数据后,数据预处理是不可或缺的环节。数据的缺失值、异常值处理以及格式转换等都需要特别关注。此外,数据清洗是后续分析和建模的基础。比如,对于分类问题中的类别不平衡问题,需要采取一些策略进行处理,例如过采样、欠采样等方法。

米兰milan,米兰milan官方网站,米兰milan,米兰milan官方网站特征工程也是竞赛前期的重要步骤。通过探索性数据分析(EDA),我们能够挖掘出有价值的特征。在这阶段,使用可视化工具(如matplotlib、seaborn)帮助更好地理解数据模式,探索特征之间的关系,进而创造更具预测能力的特征。

2、机器学习模型的构建与调优

当数据准备就绪后,下一步就是选择合适的机器学习模型进行训练。在Kaggle竞赛中,常用的模型有决策树、支持向量机(SVM)、随机森林、梯度提升树(如XGBoost、LightGBM)以及神经网络等。不同的任务要求选择不同的模型类型。

模型选择后,调参是提升模型性能的关键。调参的过程中,首先需要选择合适的损失函数,并通过交叉验证确定最佳的超参数组合。可以采用网格搜索(GridSearchCV)或随机搜索(RandomizedSearchCV)等技术,系统地调整参数,并监控验证集的表现。

在模型调优时,防止过拟合同样至关重要。为了提高模型的泛化能力,可以采用正则化方法,或者使用早停(early stopping)来防止过多的训练。除了模型本身的调优,特征选择也是不可忽视的一环,精简特征有助于减少噪声,提高模型效果。

3、团队合作与竞赛策略

Kaggle竞赛虽然是个人参加,但团队合作往往能起到事半功倍的效果。在Kaggle上,一支强有力的团队能够集思广益,互补技能。团队成员可以在数据预处理、模型构建、调参等多个方面各展所长,确保每一环节都达到最佳效果。

有效的沟通是团队成功的关键。一个团队内部的成员需要清晰地分工合作,定期进行成果分享,及时解决遇到的问题。每个人应明确自己的任务和责任,而不是盲目地重复别人的工作。通过协作和不断迭代,团队能够快速应对不同的挑战。

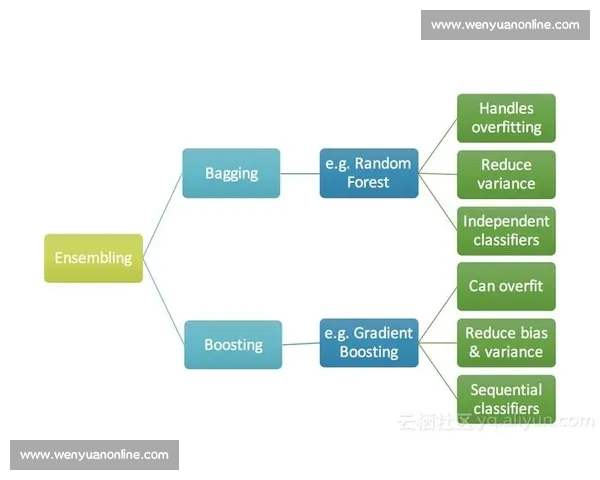

另外,团队还可以在不同阶段共享不同的模型方案,进行ensemble(集成)模型的构建,利用多个模型的优势进一步提高预测精度。集成方法如投票法(voting)、加权平均法(weighted averaging)等可以帮助提升最终的竞赛成绩。

4、竞赛评估与最终提交

Kaggle的评估标准通常采用在线评估和提交机制,最终排名依据测试集上的预测准确性。在这一阶段,参赛者需要密切关注公榜(Public leaderboard)和私榜(Private leaderboard)之间的差距,避免过度优化公榜得分,进而影响私榜结果。

为了降低模型在测试集上的波动,Kaggle参赛者常常采用交叉验证等方法,通过多次验证集分割来获得更稳定的模型性能。在进行最终提交时,确保模型没有过拟合,且能够稳健地应对不同的数据。

此外,Kaggle的评估指标(如准确率、AUC、RMSE等)也需要在竞赛过程中不断加深理解。针对不同竞赛任务,掌握这些评估指标的背后意义,才能更好地进行模型优化,最终取得较好的成绩。

总结:

Kaggle数据竞赛不仅是对参赛者机器学习能力的考验,也是对其问题解决能力、团队合作能力及项目管理能力的全面挑战。通过对数据的深入理解和合理的特征工程,构建强有力的机器学习模型,并合理利用团队协作和评估机制,参赛者能够在竞赛中脱颖而出。

总体来说,Kaggle竞赛的获胜不仅仅依赖于单一的技术或策略,而是综合性的能力展示。从数据分析、模型构建到团队合作和最终评估,所有环节都需要精心策划和执行。持续的学习和实践,不断积累经验,将是赢得Kaggle竞赛的重要保障。